Foundation модельдерін AWS платформасында даярлау және пайдалану негіздері

Жасанды интеллект саласындағы іргелі модельдерді құрастыру, жаттықтыру және одан кейінгі пайдалану технологиясы жылдам дамуда. Осы үрдістің маңызды бөлігі – бұл процестер үшін қажетті инфрақұрылым мен ресурстарды тиімді ұйымдастыру. AWS (Amazon Web Services) бұл талаптарға сай кешенді шешімдер ұсына отырып, үлгілеу кезеңдерінің әр түрлі қажеттіліктерін толықтай қамтамасыз етеді. Мақалада foundation модельдерін AWS-та басқару үшін қолданылатын негізгі құрамдас бөліктерге, олардың өзара байланысына және жұмыс істеу ерекшеліктеріне тоқталады.

Іргелі түсінік: көлденең масштабтау және ресурстардың үйлесімі

Модельдерді маштабтау дәстүрлі түрде есептеу қуатын көбейту арқылы жүзеге асатын. Зерттеулер мен тәжірибелік нәтижелер көрсеткендей, параметрлер саны, мәліметтер көлемі және есептеу ресурстары артқан сайын модельдің сапасы қарқынды жақсарады. Алайда, бұл тек бастапқы жаттықтыруға қатысты қарапайым қисын болды. Мысалы, NVIDIA компаниясының үш масштабтау заңына сәйкес, модельдердің өнімділігі тек алғашқы жаттықтырумен шектелмейді, сонымен қатар кейінгі кезеңдердегі – бақылаумен икемдеу, күшейтпелі оқыту және нақты қолдану кезінде көп қырлы есептеулер арқылы да артады.

Осыған орай, foundation модельдерінің өңделу кезеңдері – бастапқы жаттықтыру, кейінгі икемдеу және нәтижені пайдалану – біртұтас, бірақ күрделі инфрақұрылымға мұқтаж. Бұл инфрақұрылым жоғары жылдамдықты, кешігуі төмен желілік байланыс, көп мөлшерлі жадқа ие есептеу құрылғылары және мәліметтерді сенімді сақтау жүйесін қамтиды.

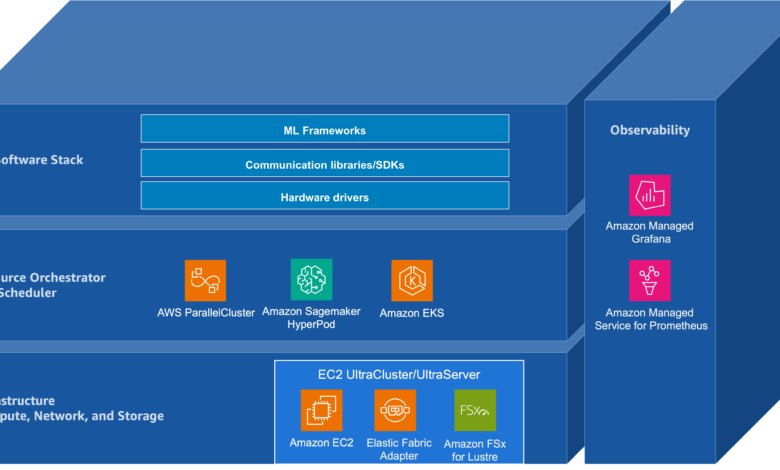

Құрылымды және құралдарды үйлестіру

Инфрақұрылымдық компоненттер тиімді жұмыс істеуі үшін ресурстарды басқару маңызды. AWS экожүйесінде бұл міндет көбінесе Slurm және Kubernetes сияқты басқару жүйелеріне жүктелген. Neural Network моделдерін дамыту кезінде PyTorch пен JAX сияқты ашық бастапқы коды бар бағдарламалық құралы пайдаланылады. Жүйенің жұмысын бақылау үшін Prometheus пен Grafana құралдары қолданылады, олар сапаны сақтауға және өнімділікті талдауға мүмкіндік береді.

Бұл қабаттар аралығында үйлестіру foundation модельдерін AWS-та өркендетуге мүмкіндік бере отырып, үлкен ауқымды есептеулер мен мәліметтер ағынын үздіксіз қамтамасыз етеді.

AWS-тағы нұсқаулық құрамдас бөліктер

Есептеу күштері және графикалық процессорлар

AWS бірнеше буындағы NVIDIA графикалық процессорларын пайдаланады. Мысалы, Amazon EC2 P отбасы H100 және H200 GPU-ларын ұсынады, ал P6 отбасы жаңа үлгідегі Blackwell B200 және B300 архитектуралары бар құрылғыларды қамтиды. Осы GPU-лардың негізгі сипаттамаларына олардың операциялық жылдамдығы, жад көлемі мен өткізу қабілеті кіреді. Олардың арасындағы айырмашылықтарды түсіну модельді оңтайлы конфигурациямен таңдау үшін аса маңызды.

Желілік байланыс

GPU-лар арасындағы байланыс екі деңгейде қарастырылады. NVLink және NVSwitch технологиялары бір түйінде орналасқан GPU-лардың жылдам және кешігусіз байланысын қамтамасыз етеді, бұл есептеулердің жылдамдығын арттырады. Ал CUDA-ны қолдайтын Elastic Fabric Adapter (EFA) жоғары өнімділікті көп түйінді кластерлерді біріктіреді, осылайша таратылған есептеулер технологиялық шекаралардың сыртында жүзеге асады.

Мәліметтерді сақтау

Модельдерді жаттықтыру мен пайдалану үлкен көлемді мәліметтерді жедел өңдеуді талап етеді. AWS дискілік кеңістігінде жылдамдық пен сенімділіктің үйлесімі үшін иерархиялық сақтау жүйелері енгізілген, мұнда жергілікті NVMe SSD жылдамдылықты арттырса, кең көлемді деректер мен бақылау нүктелерін сақтау үшін масштабталатын бұлттық сақтау қолданылады.

Қолдану жағдайлары мен мысалдар

AWS инфрақұрылымы мен ашық бастапқы коды бар бағдарламалық стек үлкен нейрондық желілерді жаттықтыруда және нақты уақытта жауап беруде сенімді шешім ұсынады. Мысалы, Amazon EC2 UltraClusters көп түйінді масштабтарды қолдай отырып, мыңдаған GPU-ларды біріктіруге мүмкіндік береді. Бұл үлкен мөлшерлі мәтіндік және бейнелік модельдерді тиімді дамытуға жағдай жасайды.

Модель дайындау процесіндегі әр түрлі кезеңдердің талаптарын ескере отырып, AWS әр түрлі сценарийлерге икемделген құралдар мен қызметтер ұсынады. Бұл олардың нақты жағдайларға—мысалы, автоматтандырылған аударма, мәтін өндеу және бейне талдау—және түрлі бизнес салаларына немесе ғылыми зерттеулерге тез бейімделуін қамтамасыз етеді.

Практикалық маңызы және әсері

AWS платформа негізінде құрастырылған инфрақұрылым және оған байланысты ашық бастапқы кешендер foundation модельдерін кәсіби деңгейде дамытуға мүмкіндік береді. TPU немесе басқа да арнайы аппараттардың орнына кеңінен таралған GPU-ларды пайдалану және тиімді басқару жүйелерін енгізу есеп беру уақыты мен ресурстарды үнемдеуге ықпал етеді.

Бұл тәсіл қолданушыларына ең озық нейрондық желілерді жылдам әрі сенімді түрде орналастыруға, масштабтауға және пайдалануға көмектеседі. Соның нәтижесінде жасанды интеллект қосымшаларына деген сұранысқа жылдам жауап беру факторы артады, демек жаңа технологиялық шешімдер мен инновациялардың пайда болу қарқыны үдейді.

Қорытынды

Foundation модельдерін жаттықтыру және пайдалану күрделі процестерді талап етеді, оның ішінде аппараттық ресурстарды жеткілікті көлемде және үйлесімді басқару маңызды орын алады. AWS осы мақсаттарға сәйкес келетін кешенді шешімдерді ұсынады, олар есептеу қуаты, желілік байланыс және сақтау мүмкіндіктерін біріктіріп, ашық бастапқы кодты бағдарламалық қабаттармен үйлеседі. Бұл архитектура foundation модельдерінің өмірлік циклін толық және тиімді жүзеге асыруға жол ашады.

Осы технологияларды игеру және қолдану жасанды интеллект саласындағы зерттеулер мен дамуды жаңа деңгейге көтереді.

TAGS: AWS, foundation модельдері, NVIDIA GPU, таратылған есептеу, жасанды интеллект, ресурстарды басқару, ашық бастапқы код

Дереккөз: Hugging Face Blog